시작하기 (Get Started)

Google Antigravity가 무엇인지 알아보고, 설치부터 첫 번째 프로젝트까지 단계별로 안내합니다.

이 페이지에 대해

이 페이지는 Google Antigravity 공식 문서와 코드랩을 한국어로 설명한 비공식 튜토리얼입니다. 최신 정보나 정확한 내용은 아래 공식 링크를 먼저 확인하세요.

Antigravity란? #

Google Antigravity는 Google이 만든 AI 코딩 에이전트입니다. 채팅으로 대화하면 AI가 코드를 작성하고, 파일을 수정하고, 터미널 명령을 실행하며, 프로젝트 전체를 이해하고 작업합니다.

본 튜토리얼은 Antigravity IDE(VS Code 기반 통합 에디터)를 기준으로 작성되었습니다. 같은 이름을 공유하는 다른 제품들과 혼동하지 않도록 4가지의 구분을 먼저 확인하세요.

| 제품 | 설명 | 본 튜토리얼 |

|---|---|---|

| Antigravity IDE 2025-11+ · 유지 중 | VS Code 기반 에디터. Agent Manager + Editor를 한 앱에 통합. Cmd+E로 두 화면 전환. | ✅ 본 튜토리얼이 다루는 제품 |

| Antigravity 2.0 2026-05-19+ | I/O 2026에서 발표된 신규 독립 데스크톱 앱. 코드 에디터는 제거되고 다중 에이전트 오케스트레이션·Subagent·스케줄링 중심. | 참고만 — 본 튜토리얼은 이 앱을 메인으로 다루지 않음 (개념 정리만 별도 제공) |

| Antigravity CLI 2026-05-19+ | Go 기반 터미널 도구. Gemini CLI의 후속(개인 사용자 2026-06-18 전환 마감). | Gemini CLI 페이지의 전환 안내 |

| Antigravity SDK 2026-05-19+ | 같은 에이전트 하네스를 프로그래밍 방식으로 호출. CI·외부 시스템 통합용. | 개요만 보강 |

두 앱은 함께 사용 가능합니다. Antigravity IDE와 Antigravity 2.0은 별도 디렉터리(Antigravity, Antigravity IDE)에 각각 설치되어 공존합니다. 2.0만 깔려 있다면 추가로 IDE를 설치하기만 하면 됩니다 — 제거 없이 동시 설치 OK. (Google이 2026-05-23 업데이트로 2.0 앱 안에 "Install IDE" / "Open IDE" 버튼을 추가해 두 앱을 같이 쓰도록 안내합니다.) 본 튜토리얼은 IDE 기준으로 작성되어 있으니 IDE 설치본을 갖춰 두세요.

바이브 코딩이란?

Andrej Karpathy가 2025년에 제안한 용어로, 코드를 직접 작성하지 않고 자연어로 AI에게 지시하여 프로그래밍하는 방식을 말합니다. "로그인 페이지 만들어줘", "이 CSV 데이터를 시각화해줘"처럼 말하면 AI가 코드를 생성하고 실행합니다.

Antigravity로 할 수 있는 것

웹사이트 & 앱 개발

"할일 관리 앱을 React로 만들어줘" 등 전체 프로젝트를 대화로 생성합니다. React, Angular, Next.js를 기본 지원하며, Firebase 백엔드 자동 연동도 가능합니다.

데이터 분석

"이 CSV 파일의 매출 추이를 그래프로 보여줘", "결측치를 처리하고 통계 요약해줘" 등 Python/pandas 분석을 수행합니다.

코드 리뷰 & 리팩토링

"이 코드의 성능 문제를 찾아줘", "테스트 코드를 추가해줘" 등 기존 코드를 분석하고 개선합니다.

문서 & 자동화

"README를 작성해줘", "배포 스크립트를 만들어줘", "GitHub 이슈를 정리해줘" 등 반복 작업을 자동화합니다.

전통 코딩 vs 바이브 코딩

다운로드 & 시스템 요구사항 공식 문서 #

antigravity.google/download에서 운영체제에 맞는 설치 파일을 다운로드하세요.

2026-05-19부터 공식 다운로드 페이지에 두 가지 설치본이 노출됩니다. 본 튜토리얼의 모든 예제는 Antigravity IDE(VS Code 기반 통합 에디터)를 기준으로 합니다.

- ✅ Antigravity IDE 설치본을 선택 — VS Code 기반, Agent Manager + Editor 통합, Cmd+E 전환. 본 튜토리얼이 다루는 환경.

- Antigravity 2.0 설치본 — 코드 에디터가 제거된 별도 데스크톱 앱(다중 에이전트 오케스트레이션 중심). 본 튜토리얼의 본 흐름과는 다르지만 같이 써도 무방합니다.

- 이미 Antigravity 2.0이 설치되어 있어도 IDE를 추가 설치하면 됩니다 — 두 앱은 별도 디렉터리(

Antigravity·Antigravity IDE)에 공존합니다. 2026-05-23 업데이트로 Antigravity 2.0 안에 "Install IDE"·"Open IDE" 버튼이 추가되어 같이 쓰는 흐름이 공식 권장입니다. 제거 없이 IDE만 추가 설치하세요.

4가지 Antigravity 제품군 전체 비교는 "Antigravity란?" 절에서 확인할 수 있습니다.

- Free tier: 일정량의 agent 요청 한도 내에서 무료 사용 (정확한 한도는 공식 요금제 페이지 참고)

- AI Pro / AI Ultra: 유료 플랜 ($20/월, $249.99/월) 가입 시 더 많은 AI credits가 제공됩니다.

- 주의: Antigravity의 사용량 단위는 자체 AI credits로, 일반적인 Google Cloud 크레딧(GCP)과는 별개입니다.

| 운영체제 | 요구사항 | 비고 |

|---|---|---|

| macOS | macOS 13.0+ (Ventura) | Intel 및 Apple Silicon(M1 이상) 모두 지원 |

| Windows | Windows 10 1809+ (64비트) | Windows Server 2019+ 지원. 네이티브 설치 시 Git for Windows 필요. WSL 2 환경에서도 사용 가능 |

| Linux | x64 또는 ARM64 | Ubuntu 20.04+, Debian 10+, Alpine Linux 3.19+ |

| 항목 | 요구사항 |

|---|---|

| 하드웨어 | 4GB+ RAM, x64 또는 ARM64 프로세서 |

| 셸 | Bash, Zsh, PowerShell, CMD |

| 네트워크 | 인터넷 연결 필요 |

| 브라우저 | Chrome (브라우저 서브에이전트 사용 시 필수) |

설치 흐름 (4단계)

Antigravity를 설치하고 처음 실행하면 아래 순서로 초기 설정이 진행됩니다.

| 단계 | 내용 | 선택지 |

|---|---|---|

| 1단계 | 기존 설정 가져오기 | VS Code / 커서(Cursor) 설정 가져오기 또는 새로 시작 중 선택 |

| 2단계 | 편집기 테마 선택 | 밝음(Light) / 어두움(Dark) 중 선택 |

| 3단계 | 에이전트 정책 설정 | 아래 초기 설치 설정 옵션 표 참고 |

| 4단계 | Google 계정 로그인 & 약관 동의 | 브라우저가 자동으로 열리며 개인 Gmail 계정으로 로그인 후 이용약관 동의 |

- 브라우저가 열리지 않는 경우: 로그인 URL이 터미널에 출력됩니다. URL을 복사해서 Chrome에서 수동으로 열어 로그인하세요.

- "계정을 찾을 수 없음" 오류: 기업·학교 계정은 지원되지 않을 수 있습니다. 개인 Gmail 계정(@gmail.com)을 사용하세요.

- 설치 파일 실행이 안 되는 경우: macOS라면 시스템 환경설정 → 보안 및 개인 정보 보호 → "확인 없이 열기"를 클릭하거나, Gatekeeper를 우회하려면 터미널에서

xattr -d com.apple.quarantine Antigravity.app을 실행하세요. - 설치 후 실행 안 됨: 공식 다운로드 페이지(antigravity.google/download)에서 최신 버전을 다시 내려받아 설치하세요.

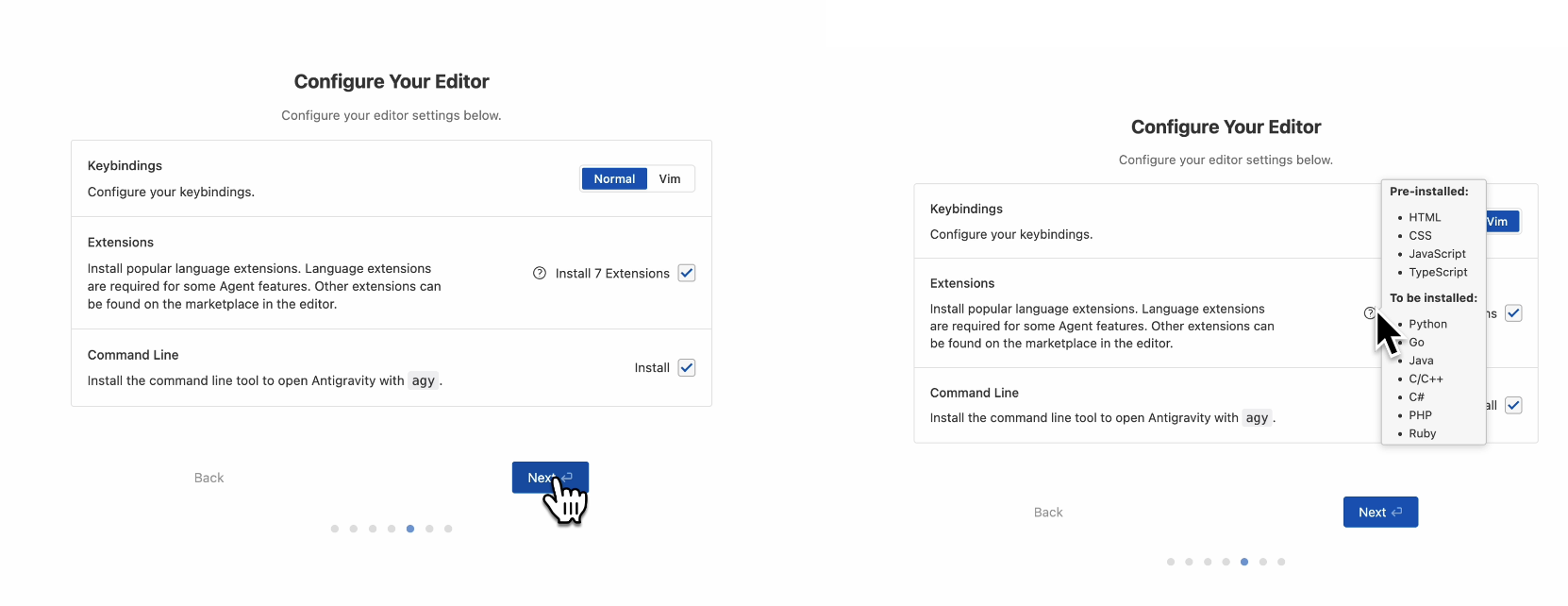

에디터 구성 화면 (Configure Your Editor) 자세히 보기

설치 마법사 중반에 등장하는 "Configure Your Editor" 단계는 그냥 Next를 눌러 넘기기 쉽지만, 여기서 결정한 값이 이후 코딩 경험에 직접 영향을 줍니다. 화면에서 확인해야 하는 항목과 권장 선택을 함께 설명합니다.

① Keybindings — 키 입력 방식

- Normal (권장 기본): VS Code와 동일한 단축키. 처음 사용한다면 이 옵션을 선택하세요.

- Vim: Vim 모달 편집을 사용. Vim 단축키에 익숙한 분만 선택. 나중에

Cmd+,→ Settings에서 언제든 전환할 수 있습니다.

② Extensions — 언어 확장 설치

Antigravity는 VS Code 기반이라 마켓플레이스 확장을 그대로 쓸 수 있습니다. 화면의 ❓ 아이콘에 마우스를 올리면 어떤 확장이 이미 깔려 있고, 어떤 게 새로 설치되는지 표시됩니다.

| 분류 | 포함 확장 | 설명 |

|---|---|---|

| Pre-installed (이미 설치됨) |

HTML, CSS, JavaScript, TypeScript | 웹 개발 기본 스택. Antigravity 기본 동작에 필요해 자동 포함됨 |

| To be installed (체크 시 설치) |

Python, Go, Java, C/C++, C#, PHP, Ruby | "Install 7 Extensions" 체크박스를 켜면 한 번에 설치. 데이터 분석을 한다면 Python 확장은 거의 필수 |

③ Command Line — agy-ide 명령 설치

체크하면 터미널에서 agy-ide 폴더경로 한 줄로 Antigravity IDE를 해당 폴더 워크스페이스로 바로 열 수 있습니다. VS Code의 code . 명령과 같은 역할입니다.

agy였으나, 신규 Antigravity CLI가 agy 이름을 차지하면서 IDE 런처는 agy-ide로 개명됐습니다. 옛 스크립트·메모에 agy 폴더경로가 있다면 agy-ide 폴더경로로 바꿔주세요.

# 현재 폴더를 Antigravity IDE로 열기

agy-ide .

# 특정 프로젝트 폴더 열기

agy-ide ~/projects/my-data-analysis

# 새 빈 창 열기

agy-ide --new-windowagy-ide 명령이 IDE 진입 속도를 크게 줄여줍니다. agy-ide는 PATH에 등록되므로, 체크하지 않으면 나중에 직접 PATH를 설정해야 합니다. 한편 agy(IDE 런처가 아닌 신규 CLI)는 Antigravity CLI 페이지에서 다룹니다.

- Keybindings →

Cmd+,(Settings) → "Keymap" 검색 후 확장 설치 - Extensions → 좌측 사이드바 ⊞ (Extensions) 아이콘 → 검색해서 개별 설치

agy-ide명령 →Cmd+Shift+P→ "Shell Command: Install 'agy-ide' command in PATH" (2026-05 개명 전엔agy였습니다)

초기 설치 설정 옵션

3단계에서 아래 3가지 정책을 설정합니다. 언제든지 설정에서 변경 가능합니다.

| 정책 | 옵션 | 설명 |

|---|---|---|

| 터미널 명령 실행 | 항상 실행 / 검토 요청 | 에이전트가 터미널 명령을 자동으로 실행할지, 매번 승인을 받을지 결정합니다. 처음에는 "검토 요청"으로 시작해서 에이전트의 명령 패턴을 파악하세요. |

| 아티팩트 검토 정책 | 항상 진행 / 에이전트 결정 / 검토 요청 | 코드 변경사항을 자동으로 적용할지, 사용자가 검토 후 결정할지 선택합니다. "에이전트 결정"은 간단한 수정은 자동 적용, 대규모 변경은 검토를 요청하는 균형 모드입니다. |

| JavaScript 실행 | 항상 실행 / 검토 요청 / 비활성화 | 에이전트가 브라우저에서 JavaScript를 실행할 수 있는 권한을 설정합니다. 신뢰하지 않는 웹 페이지를 자주 다룬다면 "검토 요청" 또는 "비활성화"를 권장합니다. |

4가지 사전 설정 구성 모드

세 가지 정책을 개별로 설정하는 대신, 공식 문서에서 제공하는 4가지 프리셋 모드 중 하나를 선택할 수도 있습니다.

| 모드 | 설명 | 적합한 상황 |

|---|---|---|

| Security Mode | 외부 리소스 접근과 민감한 작업을 제한하는 강화된 보안 설정 | 보안 감사 중, 민감한 데이터 작업, 사내 폐쇄망 환경 |

| Review-Based Development 권장 | 에이전트 자율성과 사용자 감독의 균형. 자주 검토를 요청합니다. | 처음 사용하는 경우, 새 프로젝트, 일반 개발 작업 |

| Agent-Led Development | 검토 요청 없음. 에이전트가 최대 자율성으로 작업합니다. | 반복 작업 자동화, 신뢰할 수 있는 익숙한 환경 |

| Custom Configuration | 세 가지 정책을 각각 독립적으로 설정하는 사용자 정의 모드 | 특수한 요구사항, 세밀한 제어가 필요한 경우 |

Cmd+, (Settings) → "Agent Policy"에서 언제든지 변경할 수 있습니다.

할당량 확인 방법: Google AI Studio에 접속하여 좌측 메뉴의 "API keys" 페이지에서 현재 사용량과 남은 할당량을 확인할 수 있습니다. 또는 Antigravity 에디터 내에서 모델 선택 드롭다운 옆의 사용량 표시를 통해 대략적인 잔여 할당량을 확인할 수 있습니다. 할당량은 일반적으로 분당 요청 수(RPM)와 일일 요청 수(RPD) 기준으로 제한되며, 매일 자정(태평양 표준시 기준)에 초기화됩니다.

Cmd+,)에서 언어별 확장 프로그램을 설치할 수 있습니다. Python 개발 시 Python 확장, JavaScript 개발 시 ESLint 등을 설치하면 AI 에이전트와 협업할 때 더 정확한 자동완성과 오류 감지가 가능합니다.

개발 환경 설치 가이드 #

Antigravity가 생성한 코드를 실행하려면 Python, Node.js, Git 등의 도구가 필요합니다.

Python 3.10+

데이터 분석, 스크립트 실행, 자동화. macOS 인증서 설치 안내 포함.

Node.js 18+

웹 개발, MCP 서버 연동, React/Next.js 프로젝트.

Git

버전 관리, GitHub 연동, 코드 이력 추적.

uv

차세대 Python 패키지 관리자. pip보다 10~100배 빠른 설치 속도.

모델 (Models) 공식 문서 #

대화 프롬프트 박스의 드롭다운에서 사용할 모델을 선택할 수 있습니다. 모델 선택은 대화 내 사용자 메시지 사이에서 유지(sticky)됩니다. 즉, 한 번 선택하면 대화가 끝날 때까지 해당 모델이 계속 사용됩니다.

추론 모델 (Reasoning Models)

사용자가 직접 선택하여 대화에서 사용하는 모델입니다.

| 모델 | 특징 | 추천 용도 |

|---|---|---|

| Gemini 3.1 Pro (high) | 최고 성능, 깊은 추론 | 복잡한 아키텍처 설계, 대규모 리팩토링 |

| Gemini 3.1 Pro (low) | 균형 잡힌 성능 | 일반적인 코딩, 디버깅 |

| Gemini 3 Flash | 빠른 응답 속도 | 간단한 수정, 빠른 작업 |

| Claude Sonnet 4.6 (thinking) | 뛰어난 코드 품질, 사고 과정 포함 | 코드 리뷰, 문서 작성 |

| Claude Opus 4.6 (thinking) | 최고 수준의 추론, 사고 과정 포함 | 복잡한 문제 해결, 알고리즘 설계 |

| GPT-OSS-120b | 오픈소스 기반 대규모 모델 | 다양한 범용 작업 |

추가 모델 (내부 자동 사용)

사용자가 직접 선택하지 않지만, Antigravity 내부에서 특수 목적으로 자동 사용되는 모델들입니다. 아래 모델 버전은 내부적으로 관리되며, 사용자 선택 모델과 별도로 동작합니다.

Nano Banana Pro 2

이미지 생성 전용 모델. UI 목업, 다이어그램, 차트 이미지 생성에 사용됩니다.

Gemini 2.5 Pro UI Checkpoint

브라우저 서브에이전트 전용 모델. 웹 페이지 내에서 클릭, 스크롤, 입력 등의 조작을 수행합니다.

Gemini 2.5 Flash

체크포인팅/요약 전용 모델. 컨텍스트 요약과 체크포인트 생성에 사용됩니다.

Gemini 2.5 Flash Lite

시맨틱 검색 전용 모델. 코드베이스 내 의미 기반 검색에 사용됩니다.

무료 사용량 한도 & 토큰 절약 노하우 #

Antigravity는 무료 플랜에서도 충분히 활용할 수 있지만, 일일/월간 사용량 한도가 있습니다. 한도를 이해하고 토큰을 효율적으로 사용하면 무료 플랜만으로도 상당한 생산성을 낼 수 있습니다.

무료 플랜 사용량 한도

| 항목 | 무료 플랜 | 비고 |

|---|---|---|

| 일일 요청 수 | 제한적 (모델별 차등) | 고성능 모델일수록 일일 한도가 적음 |

| 컨텍스트 윈도우 | 모델별 상이 (128K~1M 토큰) | 대화가 길어지면 이전 내용이 요약됨 |

| Flash 모델 | 상대적으로 넉넉한 한도 | 간단한 작업에 최적 |

| Pro/Opus 모델 | 상대적으로 적은 한도 | 복잡한 작업에만 선별 사용 권장 |

Antigravity 2.0 — I/O 2026 발표 2026-05-19+

I/O 2026에서 Google이 발표한 Antigravity 2.0 메이저 업데이트는 본 튜토리얼이 다루는 IDE 중심 흐름을 크게 확장합니다. 핵심 변화 6가지를 정리하면 다음과 같습니다.

| 변화 | 내용 | 사용자에게 의미 |

|---|---|---|

| 다이내믹 Subagent | 주 에이전트가 PM처럼 큰 요청을 잘게 쪼개 전문 Subagent에 위임 | 큰 작업을 하나의 대화로 끌고 가지 않아도 됨 — 자동 분업 |

| 스케줄링된 작업 | 특정 시간·트리거에 백그라운드 자동 실행 | 야간 빌드·리포트 생성·반복 점검 자동화 |

| SDK·CLI 통합 | 같은 에이전트를 데스크톱·SDK·CLI에서 동일하게 운영 | 로컬 실험 → 자동화 파이프라인 이식이 매끄러움 |

| 음성 입력 | 프롬프트 박스 실시간 음성 전사 | 긴 지시문을 말로 빠르게 입력 가능 |

| Google AI Studio · Android · Firebase 연동 | 프로젝트를 Studio·모바일·Firebase로 한 번에 연결 | 웹·모바일·백엔드를 같은 에이전트가 동시 관리 |

| Antigravity CLI (Gemini CLI 후속) | Go 기반 신규 CLI. 기존 Gemini CLI는 2026-06-18에 개인 사용자용 요청 중단 | 터미널 흐름이 Antigravity 데스크톱과 같은 아키텍처를 공유 |

요금제 — Free · Pro · AI Ultra (2026년 봄 개편 + I/O 2026)

I/O 2026에서 AI Ultra 플랜이 두 단계로 재편됐습니다. $100/월(신규, Pro 대비 5배 한도) 진입 옵션이 생겼고, 기존 최상위 플랜은 $250 → $200/월로 인하되며 20배 한도를 그대로 유지합니다. Pro·Ultra 사용자는 pay-as-you-go 탑업 크레딧으로 추가 사용량을 그때그때 충전할 수도 있습니다.

자세한 가격·할당량은 변경이 잦으므로 본 표는 흐름을 잡는 용도로 보고 결제 전 공식 가격 페이지에서 최신 수치를 확인하세요.

| 플랜 | 월 요금 | 대상 | 주요 한도·혜택 |

|---|---|---|---|

| Free | $0 | 학습·개인 실험 | 제한된 일일 요청 + Gemini 3.5 Flash 중심. 본 튜토리얼의 모든 예제 진행 가능. |

| Pro | $20 | 개인 개발자·소규모 팀 | 봄 개편으로 한도 완화 — Pro 모델 여유 / Browser Subagent 우선 처리 / 컨텍스트 윈도우 확장. |

| AI Ultra 신규 $100 (2026-05) | $100 | 고강도 개인 사용·소규모 팀 | Pro 대비 5배 한도 / Antigravity 우선 접근 / 20TB 클라우드 / YouTube Premium 포함 / Subagent·스케줄링 한도 우대. |

| AI Ultra $200 (인하: 옛 $250) | $200 | 고강도 사용·팀 협업·엔터프라이즈 검토 | Pro 대비 20배 한도 유지 / 모든 Antigravity 기능 우선 접근 / 가장 큰 컨텍스트 윈도우 / 병렬 에이전트·Subagent 최상위 한도. |

모델 라인업 — 2026년 5월 현재

채팅 모델 드롭다운에서 선택할 수 있는 주력 모델입니다. 모델별 사용 시점은 모델 선택 절 참고. 본 표는 분기마다 변경되므로 최신 정보는 공식 문서 우선.

| 모델 | 특징 | 권장 사용 |

|---|---|---|

| Gemini 3.5 Flash 기본값 (2026-05) | I/O 2026에서 Antigravity 기본 모델로 지정. 거의 모든 벤치마크에서 Gemini 3.1 Pro를 앞서며 약 4배 빠름. Antigravity로 공동 개발. | 대부분 일반 작업의 새 기본 — 모델을 굳이 바꾸지 않으면 이것이 사용됨 |

| Gemini 3.x Pro | 이전 세대 범용 고성능 모델. 폭넓은 컨텍스트 윈도우 보유. | 특정 벤치마크가 3.5 Flash보다 유리한 작업이거나 기존 워크플로 호환이 필요할 때 |

| Gemini Flash (이전) | 가벼운 일반 모델. 신규 3.5 Flash가 도입되면서 대체 흐름. | 간단 수정·짧은 질문·자주 반복되는 자동화 (기존 사용 유지 시) |

| Gemma 4 | 5월 멀티모달 강화. UI 스크린샷·디자인 이미지 해석에 적합. | 이미지 첨부 분석·디자인 리뷰·시각 자료 기반 작업 |

| Gemini Omni Flash 2026-05-19+ | I/O 2026 발표 첫 Omni 계열 모델. 텍스트·이미지·오디오·비디오 입력 → 비디오 출력의 any-to-any 멀티모달. 캐릭터 일관성·SynthID 워터마크 내장. | 코딩 본 작업에는 부적합 — 영상·디자인 산출물이 필요한 사이드 작업용. 현재 주 노출처는 Gemini 앱·Google Flow·YouTube Shorts. |

| 로컬 LLM (Ollama / LM Studio) 2026-05+ | 로컬 호스팅 모델 연결 안정화. 네트워크 격리 환경에서 사용 가능. | 오프라인·기업 내부망·민감 데이터 작업 |

토큰 절약 핵심 전략

AI 코딩 에이전트에서 토큰은 곧 사용량이자 비용입니다. 같은 결과를 더 적은 토큰으로 달성하는 것이 핵심입니다.

1. 모델을 작업에 맞게 전환

모든 작업에 최고 성능 모델을 쓸 필요 없습니다.

- 간단한 수정/포맷 변환 → Flash 모델

- 일반 코딩/디버깅 → Pro (low)

- 복잡한 설계/리팩토링 → Pro (high) / Opus

대화 중간에도 모델 전환이 가능합니다.

2. MCP 대신 Skill 사용

Skill은 Progressive Disclosure로 필요한 지시만 로드하여 토큰을 절약합니다.

- MCP: 매 턴마다 전체 도구 스키마를 주입 (토큰 소비 높음)

- Skill: 활성화될 때만 관련 지시사항 로드 (토큰 소비 낮음)

자세한 비교는 Skill vs MCP 비교 섹션을 참고하세요.

3. 프롬프트를 짧고 명확하게

긴 설명보다 핵심 요구사항만 전달하세요.

- 불필요한 배경 설명이나 반복 제거

- 구체적 파일명, 함수명을 직접 지정

- 한 번에 하나의 명확한 작업 요청

입력 토큰이 줄면 출력도 간결해집니다.

4. 새 대화로 컨텍스트 리셋

대화가 길어지면 누적된 컨텍스트가 매 턴마다 재전송됩니다.

- 작업 완료 후 새 대화 시작 → 컨텍스트 초기화

- 관련 없는 주제 전환 시 새 대화 권장

- Rules 파일에 핵심 규칙을 저장해두면 매번 설명 불필요

긴 대화 1개보다 짧은 대화 여러 개가 효율적입니다.

고급 절약 테크닉

| 테크닉 | 절약 효과 | 방법 |

|---|---|---|

| Rules 파일 활용 | 반복 입력 제거 | 코딩 스타일, 규칙을 GEMINI.md/Rules에 저장 → 매 대화마다 자동 적용 |

| Workflow 자동화 | 멀티스텝 프롬프트 절감 | 반복 작업을 Workflow로 정의 → /run-eda 한 줄로 실행 |

| @ 파일 참조 | 불필요한 파일 탐색 방지 | @파일명으로 직접 참조 → 에이전트가 파일을 찾느라 토큰 낭비 방지 |

| 체크포인트 활용 | 롤백 시 토큰 재소비 방지 | 중요 시점에 체크포인트 저장 → 실패 시 처음부터 다시 하지 않아도 됨 |

| MCP 서버 최소화 | 시스템 프롬프트 토큰 절감 | 필요한 MCP 서버만 활성화 → 불필요한 도구 스키마 주입 방지 |

| 이미지/스크린샷 최소화 | 입력 토큰 대폭 절감 | 이미지는 수천 토큰 소비 → 텍스트 설명으로 대체 가능하면 대체 |

토큰 사용 시나리오 비교

"이 프로젝트의 전체 구조를 파악하고, 모든 파일을 검토한 다음, 성능이 느린 부분을 찾아서, 최적화 방안을 제시하고, 리팩토링까지 해줘"

하나의 프롬프트에 5개 작업을 포함. 에이전트가 모든 파일을 탐색하며 대량의 토큰 소비.

"@src/api/handler.ts 파일의 processRequest 함수에서 N+1 쿼리 문제를 수정해줘"

파일과 함수를 직접 지정. 에이전트가 바로 해당 위치로 이동하여 최소 토큰으로 작업 완료.

Q. 무료 플랜으로 실무에 충분한가요?

간단한 코딩 작업, 학습, 프로토타이핑에는 무료 플랜으로 충분합니다. 다만 하루 종일 고성능 모델을 사용하는 대규모 프로젝트에서는 한도에 도달할 수 있습니다. 위의 절약 테크닉을 적용하면 무료 플랜의 실질적 활용도를 2~3배 이상 높일 수 있습니다.

Q. 토큰 사용량을 실시간으로 확인할 수 있나요?

Antigravity 인터페이스에서 현재 대화의 토큰 사용량을 확인할 수 있습니다. 대화 프롬프트 영역에서 토큰 카운트를 모니터링하고, 사용량이 많아지면 새 대화를 시작하는 것이 좋습니다.

Q. 컨텍스트 윈도우가 가득 차면 어떻게 되나요?

컨텍스트 윈도우 한도에 가까워지면 에이전트가 이전 대화 내용을 자동으로 요약(compaction)합니다. 요약 과정에서 세부 정보가 손실될 수 있으므로, 중요한 결정사항이나 맥락은 Rules 파일이나 주석으로 코드에 남겨두는 것이 좋습니다. 체크포인트 기능을 활용하면 작업 진행 상황을 저장할 수도 있습니다.

데이터 분석 활용 시작하기 #

Antigravity를 데이터 분석에 활용하는 방법을 소개합니다. 모델 선택과 프롬프트 작성법을 데이터 분석 관점에서 살펴봅니다.

데이터 분석을 위한 모델 선택 가이드 (2026-05 기준)

I/O 2026 이후 Gemini 3.5 Flash가 Antigravity 기본 모델로 지정됐고(Gemini 3.1 Pro 대비 4배 빠르며 거의 모든 벤치마크 우위), 멀티모달용 Gemini Omni Flash·이미지 해석 강화된 Gemma 4도 가세했습니다. 데이터 분석 작업별 최신 추천:

| 분석 작업 | 추천 모델 | 이유 |

|---|---|---|

| 일반 EDA · 빠른 반복 작업 | Gemini 3.5 Flash (기본값) | 2026-05 신규 기본 모델. 거의 모든 벤치마크에서 3.1 Pro 우위 + 4배 속도. 별도 변경 안 하면 이것이 동작. |

| 대규모·복잡 EDA·심층 추론 | Gemini 3.x Pro (high) | 긴 컨텍스트가 필요한 다중 파일·복잡 의존성 분석 시 여전히 유리 |

| 이미지·UI 스크린샷 해석 | Gemma 4 | 2026-05 멀티모달 강화. 차트·대시보드·UI 캡처 분석에 적합 |

| 영상·다중 매체 산출물 | Gemini Omni Flash | 텍스트·이미지·오디오·비디오 → 비디오 any-to-any. 분석 결과를 영상 브리핑으로 변환할 때 |

| 통계 모델링·ML 파이프라인 설계 | Claude Opus 4.6 (thinking) | 복잡한 알고리즘 설계·하이퍼파라미터 추론 강점 |

| 분석 보고서 작성·문서화 | Claude Sonnet 4.6 (thinking) | 인사이트 정리·서술형 결론 작성에 적합 |

| 네트워크 격리 환경·민감 데이터 | 로컬 LLM (Ollama / LM Studio) | 2026-05 백엔드 안정화. 클라우드 송신 없이 로컬에서 동작 |

/models 명령으로 확인할 수 있습니다 (Antigravity CLI 빠른 시작 참고).

효과적인 데이터 분석 프롬프트

나쁜 예시

"이 데이터 분석해줘"

-- 어떤 데이터인지, 어떤 분석을 원하는지 명시되지 않아 모호함

좋은 예시

"sales_2024.csv 파일을 pandas로 불러와서 월별 매출 추이를 matplotlib 선 그래프로 시각화하고, 이상치가 있는지 IQR 방법으로 탐지해줘."

-- 파일, 도구, 분석 방법, 시각화 방식이 명확함

난이도별 프롬프트 예시

| 난이도 | 프롬프트 예시 | 핵심 포인트 |

|---|---|---|

| 입문 | "data.csv를 불러와서 기본 통계를 보여줘" | 파일명 + 원하는 결과 |

| 중급 | "customers.xlsx의 연령대별 구매 금액을 seaborn 박스플롯으로 비교하고, 이상치는 제거해줘" | 파일 + 분석 축 + 시각화 도구 + 전처리 |

| 고급 | "sales_q1.csv와 sales_q2.csv를 merge해서 전분기 대비 카테고리별 성장률을 계산하고, 상위 5개 카테고리는 plotly 인터랙티브 차트로 시각화해줘. 결과는 reports/ 폴더에 HTML로 저장해" | 다중 파일 + 비즈니스 로직 + 특정 도구 + 출력 형식 |

에이전트 (Agent) #

Antigravity의 핵심 — 에이전트의 구성요소부터 모드·설정, Rules·Skills·Workflows 개요, 병렬 대화까지 다룹니다. 분량이 많아 별도 페이지에 정리했습니다.

에이전트 종합 가이드 →

핵심 구성요소(시스템 프롬프트·도구·메모리·플랜 모드), 에이전트 모드 & 설정(Planning/Fast, 보안 모드), Rules·Skills·Workflows 개요, 병렬 대화를 한 페이지에 정리.

Skill vs MCP — 언제 무엇을 쓸까? →

커뮤니티 자주 묻는 질문. 외부 서비스 호출은 MCP, 다단계 코드 작업·도메인 지식은 Skill — 의사결정 트리와 실전 예시로 정리.

도구 & 연동 (Tools & Integration) #

MCP(Model Context Protocol)로 외부 서비스를 연결하고, Browser Subagent로 웹을 자동 조작합니다. 분량이 많아 별도 페이지에 정리했습니다.

MCP (Model Context Protocol) →

로컬 도구·DB·외부 서비스를 표준 프로토콜로 연결. 설정 파일 구조, 5단계 연결 절차, OAuth/Bearer Token 인증, GitHub MCP 실전 가이드, 30+ 지원 서버 목록까지 한 페이지에 정리.

Browser Subagent →

Antigravity에 연결되는 Chrome 확장으로 웹 페이지 자동 조작·DOM 읽기·스크린샷을 수행. 설치 절차와 주요 도구·페이지 읽기 방식까지 같은 페이지에 함께 다룹니다.

결과물 (Knowledge & Artifacts) #

에이전트의 영구 메모리 시스템인 Knowledge Items와 코딩 세션에서 자동 생성되는 Artifacts를 알아봅니다. 분량이 많아 별도 페이지에 정리했습니다.

Knowledge Items →

에이전트가 코딩 세션에서 얻은 인사이트·패턴·솔루션을 자동 캡처해 저장하는 영구 메모리 시스템. Persistent Memory·Code Examples·Coding Decisions·Custom Notes 4가지 유형과 실제 활용 예시까지 한 페이지에 정리.

다음 단계 — 후속 코드랩 #

이 튜토리얼을 마쳤다면 아래 Google 공식 후속 코드랩으로 더 깊이 학습해 보세요.

추천 학습 경로

| 단계 | 주제 | 배우는 것 | 소요 시간 |

|---|---|---|---|

| 1단계 | Antigravity 시작하기 (지금 이 페이지) | 설치, 기본 네비게이션, 에이전트 대화 시작 | 1~2시간 |

| 2단계 | Rules (규칙) 작성 | 에이전트 행동 지침 정의, Global/Workspace 규칙 | 2~3시간 |

| 3단계 | Skills (스킬) 만들기 | 재사용 가능한 전문 지식 패키지 작성 | 3~4시간 |

| 4단계 | Workflows 자동화 | 반복 작업 슬래시 명령으로 자동화 | 2~3시간 |

| 5단계 | Harness Engineering | 보안, 훅, MCP 연동, 팀 설정 | 4~6시간 |

| 심화 | 공식 후속 코드랩 (아래) | 실제 앱 빌드, Cloud 배포 | 각 2~4시간 |

Google Cloud에 빌드 및 배포

Antigravity로 만든 앱을 Google Cloud의 서버리스 환경에 배포합니다. Cloud Run, Firebase 등 클라우드 배포 실습을 다룹니다.

공식 코드랩 바로가기 →- antigravity.google — 공식 홈페이지

- antigravity.google/docs — 공식 문서

- antigravity.google/use-cases — 활용 사례

- antigravity.google/download — 다운로드

- youtube.com/@googleantigravity — 공식 YouTube 채널

- Getting Started with Google Antigravity (한국어 코드랩)